Ollama:部署与使用

Ollama 是大模型的运行平台,本文主要介绍 Ollama 的安装与使用。

安装

听说 Ollama 类似于 Docker 一样,出了 Desktop 版本,所以这次我选择下载 .dmg 文件方式安装。

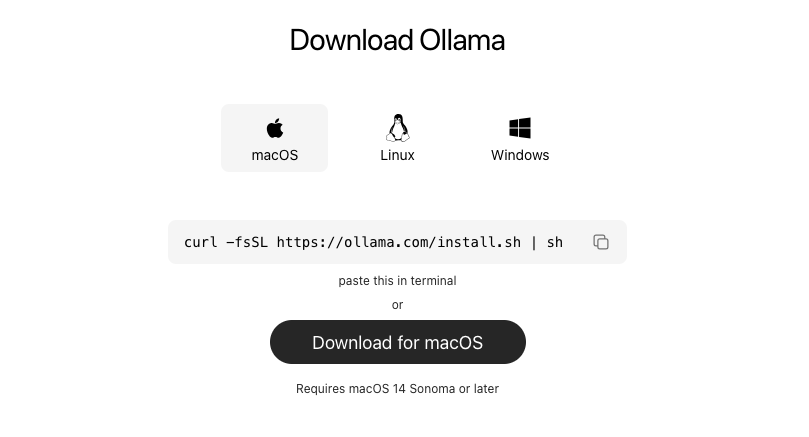

访问官网下载页面 https://ollama.com/download

下载 .dmg 安装文件

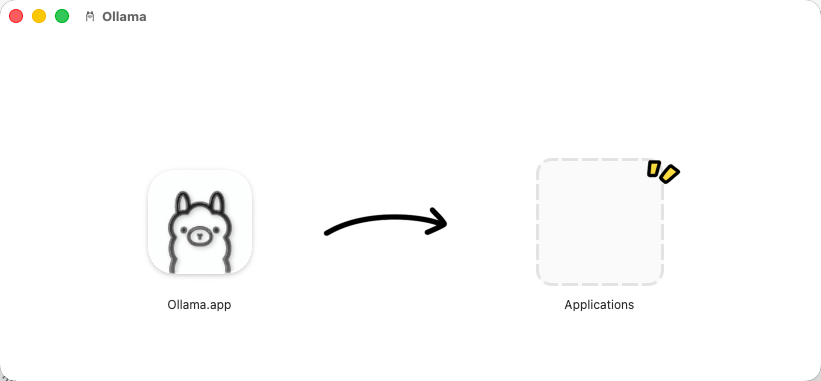

双击安装,拖动图标至 Applications

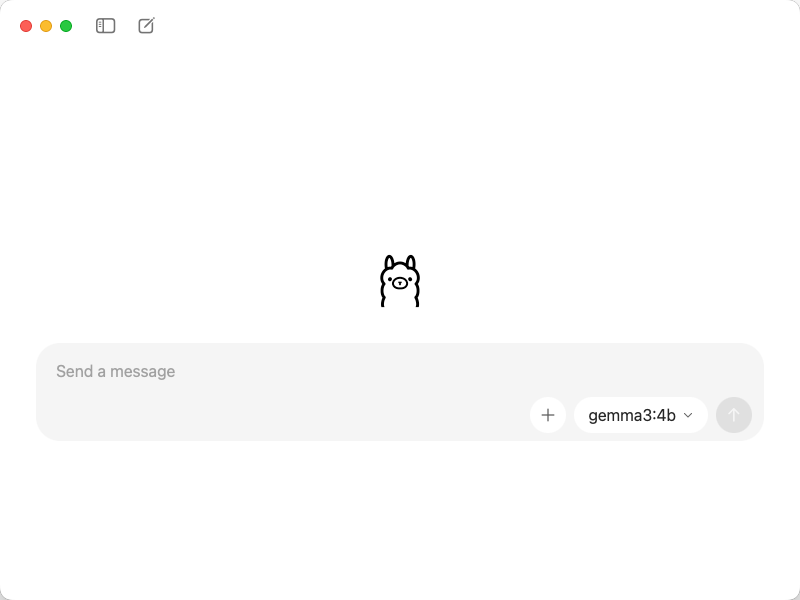

打开程序,如下图:

Desktop

Terminal

下载模型

考虑到磁盘的现有空间和后续使用,先下两个小模型使用,分别是 qwen3.5:2b 和 qwen3.5:9b。

| |

| 模型名称 | 大小 | 上下文大小 | 输入 |

|---|---|---|---|

| qwen3.5:2b | 2.7G | 256K | 文本/图片 |

| qwen3.5:9b | 6.6G | 256K | 文本/图片 |

ollama 的子命令规则与 docker 相似。

使用

查看当前环境的模型

启动 Ollama

- 点击桌面图标启动

- 命令行启动

| |

运行模型

按 Ctrl + D 退出。

查看已运行模型

停止运行模型

| |

API 文档

Ollama 默认运行在 11434 端口,所以 Base URL 为:

| |

使用 cURL 调用模型列表接口,如下:

| |

!注意!

API 文档中有两个功能相似的接口:

- POST /api/generate

- POST /api/chat

两者的区别在于:/api/generate 用于单次文本的生成,/api/chat 用于多轮对话,如下两个调用示例:

| |

| |

支持多轮对话,则需要在 messages 数组中加入对话内容。